生成AI

生成AIとは、データから新しいコンテンツや情報を「生み出す」ための人工知能の技術です。

この技術は、特定のデータセット(例: 画像、音楽、文章など)から学習し、その学習結果を基に新しいデータを生成することができます。

GAN

GAN(Generative Adversarial Network:敵対的生成ネットワーク)は、生成型の深層学習モデルの一種です。

GANは、生成器と識別器という二つのニューラルネットワークを持っています。

生成器は、ランダムなノイズを入力として受け取り、これを使って新しいデータ(例:画像)を生成します。

識別器は、生成器が生成したデータと、本物のデータを受け取り、それが生成されたものか本物かを判定します。

学習の過程では、生成器はより本物らしいデータを生成しようと努力し、識別器は生成されたデータと本物のデータをより正確に識別しようと努力します。この相互の競争により、生成器は次第に高品質なデータを生成するようになります。

最終的には、生成器が作成するデータは、識別器にとって本物と見分けがつかないほど高品質になることを目指します。この特性により、GANは画像生成、スタイル変換、超解像などの多岐にわたるタスクで利用されています。

GANの生成器と識別器の相互作用は「偽札作成者と警察官」のゲームとして例えることができます。

- 偽札作成者(生成器):

- 彼の目的は、本物そっくりに見える偽札を作ることです。

- 初めは技術が未熟で、偽札は容易に見破られます。

- しかし、警察官に何度も捕まるうちに、彼は偽札のクオリティを向上させていきます。

- 警察官(識別器):

- 彼の役割は、本物のお札と偽札を見分けることです。

- 初めは未熟な偽札を容易に見破ることができますが、偽札作成者が技術を磨くにつれ、その判別は難しくなっていきます。

- そのため彼も、より正確に偽札を見破るためのスキルを磨いていきます。

このゲームは繰り返し行われます。偽札作成者は常に本物に近づくように努力し、警察官は常に正確に偽札を見破れるように努力します。最終的には、偽札作成者は非常に高品質な偽札を作成することができ、警察官は非常に微細な違いまで判別できるようになります。

この例え話を通じて、GANの性質を理解できます。生成器と識別器の間の「競争」によって、最終的には高品質な生成物が得られるという点がポイントです。

応用例

生成AIは以下のような用途に利用することができます。

- 画像生成: 既存の画像から新しい画像を生成することができます。例えば、絵画のスタイルを模倣して新しい絵を描くことができます。

- 文章生成: 与えられたテキストデータを基に、新しい文章や物語を生成します。

- 音楽生成: ある音楽のスタイルやリズムを学習し、新しいメロディや曲を作り出すことができます。

- 映像生成: リアルタイムでの映像生成や、特定のシナリオに基づいたアニメーションの生成が可能です。

生成AIはその高度な技術と多様な応用可能性から、エンターテインメント、広告、研究など、さまざまな分野での利用が進められています。

生成AIのメリットとデメリットを分かりやすくまとめます。

生成AIのメリット:

- 効率的なコンテンツ生成: 手動での作成に比べ、大量のコンテンツやデータを迅速に生成することができます。

- クリエイティブなアウトプット: 既存のデータにない新しいコンテンツやアイデアを生み出すことができます。

- カスタマイズ: 特定の要件や基準に基づいてコンテンツを生成することができます。

- コスト削減: 手動のコンテンツ制作に比べて、時間やリソースのコストを削減することが可能です。

生成AIのデメリット:

- 品質のバリエーション: 生成されたコンテンツの品質が一定でない場合があります。

- 偏見の問題: 学習データに含まれる偏見が生成コンテンツに反映される可能性があります。

- 信頼性の問題: 人工的に生成された情報は、信頼性が低く誤解を生むことがある。

- 著作権の問題: 既存のコンテンツを基にした生成結果が著作権の問題を引き起こすことがある。

以上が、生成AIの主なメリットとデメリットです。

AIと倫理

AI(人工知能)が急速に発展する中で、その適切な利用や制御に関する倫理的な問題が浮上しています。

AIは、自動化された決定や予測を行うためにデータを利用しますが、そのデータが偏ったり不適切である場合、差別や不公平な結果を生むことがあります。

また、AIがプライバシーの侵害や個人情報の悪用につながる可能性もあります。

これらの問題を解決するためには、AIの開発・利用に関する倫理的なガイドラインや法的な枠組みが必要です。AIの適切な利用を通じて、より公正で透明性の高い社会を目指すべきです。

人間中心のAI社会原則

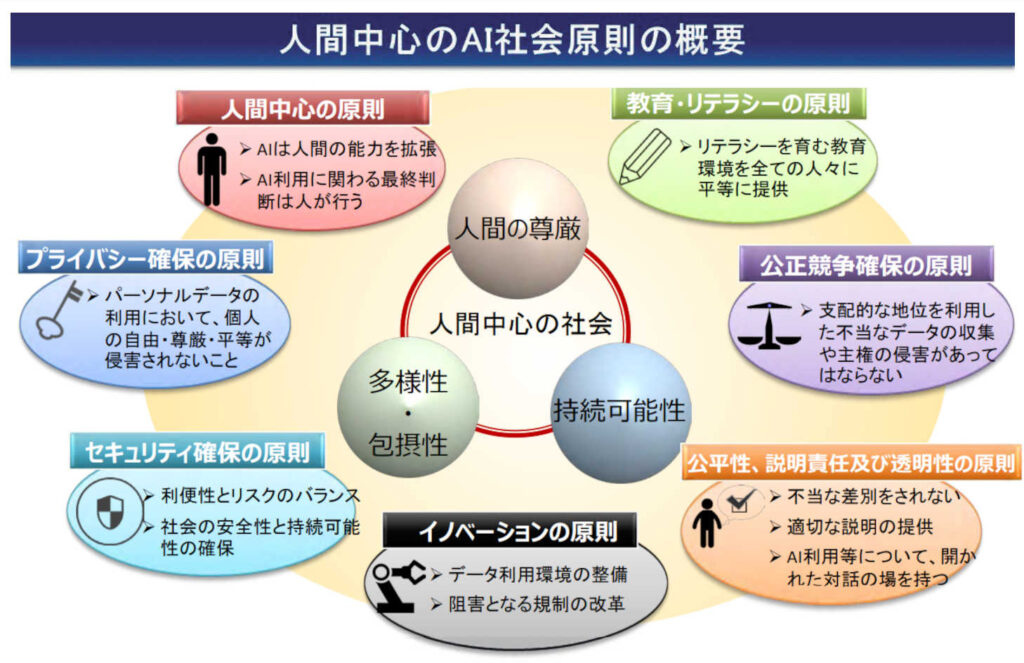

「人間中心のAI社会原則」とは、AI技術が進歩し広く普及していく中で、その利用が人間の尊厳、多様性・包摂性、持続可能性を尊重し、社会全体に利益をもたらすように意図し、定められた指針です。

この原則は、AIがただ技術的に進歩するだけでなく、社会全体にとって良い影響をもたらすように開発するためのガイドラインとして作られています。以下で、この原則の重要な点をわかりやすく説明します。

基本理念は以下の3つです。

- 人間の尊厳: AIは人間の尊厳を尊重し、人間がAIを使いこなすことで能力や創造性を発揮できる社会を目指す。

- 多様性・包摂性: AIは、すべての人が活躍し、幸せを追求できる多様性と包摂性を尊重する社会を目指す。

- 持続可能性: AIは、地球規模のサステイナビリティの課題に対処し、持続可能な社会を実現するために貢献する。

基本原則は以下の7つです。

- 人間中心の原則: AIは人間を補完し、人間が決定を行う社会を目指す。

- 教育・リテラシーの原則: すべての人がAIを理解し、正しく利用できるような教育が必要。

- プライバシー確保の原則: AIの時代においては、個人情報を安全に保ち、慎重に扱うことが非常に重要。

- セキュリティ確保の原則: 社会システムの安全性を維持し、セキュリティリスクに対処する。

- 公正競争確保の原則: AIに関する資源の公平な分配と健全な競争を促進する。

- 公平性・説明責任及び透明性の原則: AIの利用は公平であり、その決定根拠は透明であるべき。

- イノベーションの原則: AI技術の健全な発展と社会実装を促進し、阻害要因となっている規制の改革を行う。

これらの原則は、AI技術が社会の福祉を向上させ、倫理的かつ責任ある方法で利用されることを目指しています。政府はこれらの原則を基にAI政策を策定し、実践しています。

参考:統合イノベーション戦略推進会議決定「人間中心の AI 社会原則」(PDFファイル)

AI利活用ガイドライン

AI利活用ガイドラインは、総務省の「AIネットワーク社会推進会議」がAIサービスの提供者・利用者が利活用段階において留意することが期待される事項を「原則」(全10原則)という形式でまとめ、その解説を記載したものです。

| ① 適正利用の原則 | 利用者は、人間とAIシステムとの間及び利用者間における適切な役割分担のもと、適正な範囲及び方法でAIシステム又はAIサービスを利用するよう努める。 |

| ② 適正学習の原則 | 利用者及びデータ提供者は、AIシステムの学習等に用いるデータの質に留意する。 |

| ③ 連携の原則 | AIサービスプロバイダ、ビジネス利用者及びデータ提供者は、AIシステム又はAIサービス相互間の連携に留意する。また、利用者は、AIシステムがネットワーク化することによってリスクが惹起・増幅される可能性があることに留意する。 |

| ④ 安全の原則 | 利用者は、AIシステム又はAIサービスの利活用により、アクチュエータ等を通じて、利用者及び第三者の生命・身体・財産に危害を及ぼすことがないよう配慮する。 |

| ⑤ セキュリティの原則 | 利用者及びデータ提供者は、AIシステム又はAIサービスのセキュリティに留意する。 |

| ⑥ プライバシーの原則 | 利用者及びデータ提供者は、AIシステム又はAIサービスの利活用において、他者又は自己のプライバシーが侵害されないよう配慮する。 |

| ⑦ 尊厳・自律の原則 | 利用者は、AIシステム又はAIサービスの利活用において、人間の尊厳と個人の自律を尊重する。 |

| ⑧ 公平性の原則 | AIサービスプロバイダ、ビジネス利用者及びデータ提供者は、AIシステム又はAIサービスの判断にバイアスが含まれる可能性があることに留意し、また、AIシステム又はAIサービスの判断によって個人が不当に差別されないよう配慮する。 |

| ⑨ 透明性の原則 | AIサービスプロバイダ及びビジネス利用者は、AIシステム又はAIサービスの入出力等の検証可能性及び判断結果の説明可能性に留意する。 |

| ⑩ アカウンタビリティの原則 | 利用者は、ステークホルダに対しアカウンタビリティ(説明責任)を果たすよう努める。 |

参考:AIネットワーク社会推進会議「AI利活用ガイドライン」(PDFファイル)

関連用語

ハルシネーションとは、生成AIが実際の事実や関連性とは異なる、しかしもっともらしい情報を生成する現象を指します。

以下に具体例を挙げます。

- 画像生成: 生成された画像に、実際の絵や写真には存在しないような奇妙な形や色が現れる。

- テキスト生成: 事実に基づかない文章が生成されたり、文の中に意味不明な文言が挿入されたりする。

ハルシネーションの原因として、以下の理由が考えられます。

- 学習データの誤り:学習データに誤りや不正確な情報が含まれている場合、AIはその誤ったデータに基づいて新しい情報を生成することがあります。

- 学習データの不足: AIが学習するデータが不十分な場合、データにない情報を補完しようとすることがあります。

- モデルの過学習: AIが学習データに過度に適合すると、学習データのノイズや偶発的なパターンを真実として捉え、それを基に新しいデータを生成することがあります。

ハルシネーションは、生成AIの品質や信頼性に影響を与えるため、モデルの学習や調整段階で注意が必要です。

※ハルシネーション(hallucination)とは「幻覚」「幻影」という意味の英単語です。